RNNで「てにをは」を校正する

RNNで「てにをは」を校正する

はじめに

RNNによる文章校正がリクルートによって提案されて以来、調査タスクとして私のものとに来たりして、「できるんでしょう?」とか軽く言われるけど、実際には簡単にはできません。

RNNによる文章生成ができるから、校正もできるというのが人間の自然な発想なのかもしれませんが、英語と日本語の違いに着目した場合、英語がアルファベットのみで構築されるのに比べて日本語は、漢字・ひらがな・カタカナと非常に多く、同じように問題を適応すると、すごい高次元の問題を解くこととなり、理想的なパフォーマンスになかなかなりません。

まぁ、あんまり完成してるわけでない技術を完成したようにプレスリリースを出す企業様の印象操作もあり、正直どうかと思うんですけどね...まぁそれはいいです。

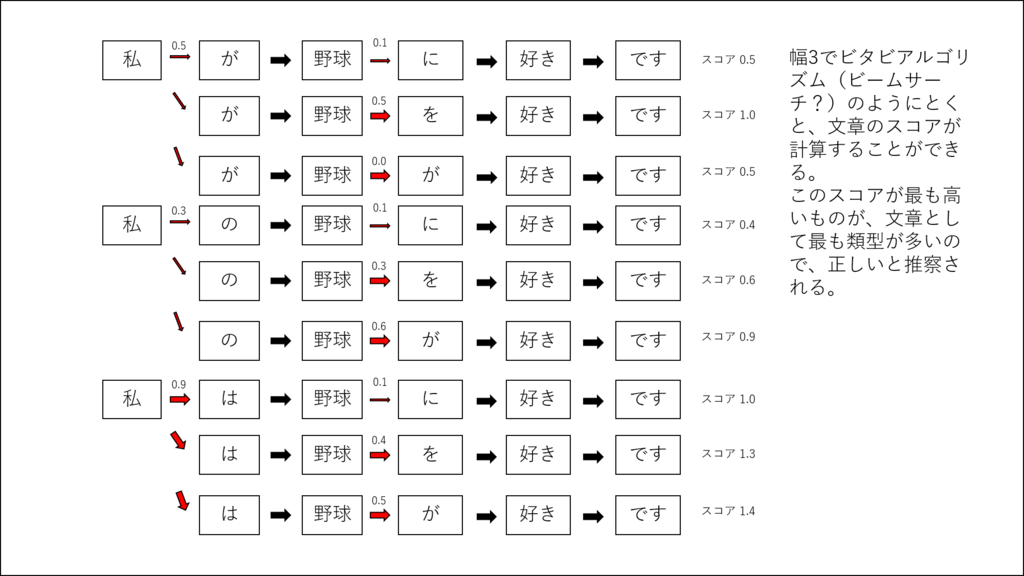

さて、リクルートは文章生成プログラムとビームサーチで「てにをは」を修正するディープラーニングがあるということですが、RNNとビームサーチで実装したとのことです[1]

いささか、どのように実装したのか不明瞭であったので、まとめ直しました。多分こういうことでしょう。

さて、問題となるのが、計算量です。幅3で一文を探索した場合でも、修正する助詞が3つあれば、9回の評価が必要になります。しかも、GRUやLSTMは状態を保存するので、モデルの状態を固定して9つ別個に走らせる必要があるので、9倍のメモリも必要になります。(実はわたしは、このアプローチはだいぶ前に試して、お蔵入りにしました)

これを別のアプローチで解決していきます。

問題

文章校正ではコンテンツを持つ企業であれば、どこでも直面する問題であるので、RNNでの文章校正に意欲を燃やす企業が多い。

このモチベーションは素人ライターや文章をあまり書いたことのない人などが、内容はおいておき、「てにをは」がおかしかったり、単語チョイスがおかしかったりすることに起因していて、直すのは人手が現在はほとんどであり、大変工数がかかるので簡易化したいという思惑があったりする。

とくにキュレーションサービスを抱えている業者は、素人の日本語が変だったりして、修正することが多い。キュレーションサイト自体は、現在では、盗用であったり、健康に害を及ぼすニセの情報の発信も問題とされている。DeNAでは大炎上して40億近くも溶かしたらしい、人の命に関わる問題で適当やらかしたら、しょうがない気もする[2]

問題のスコープを限定して、コンテンツの真偽性の検証ではなくて、「てにをは」の修正に焦点を当てる。

また、キュレーションサイトに素人文章が多いということを利用して、修正箇所が多いほうが、キュレーションサイトであるという仮説を検証する。

提案

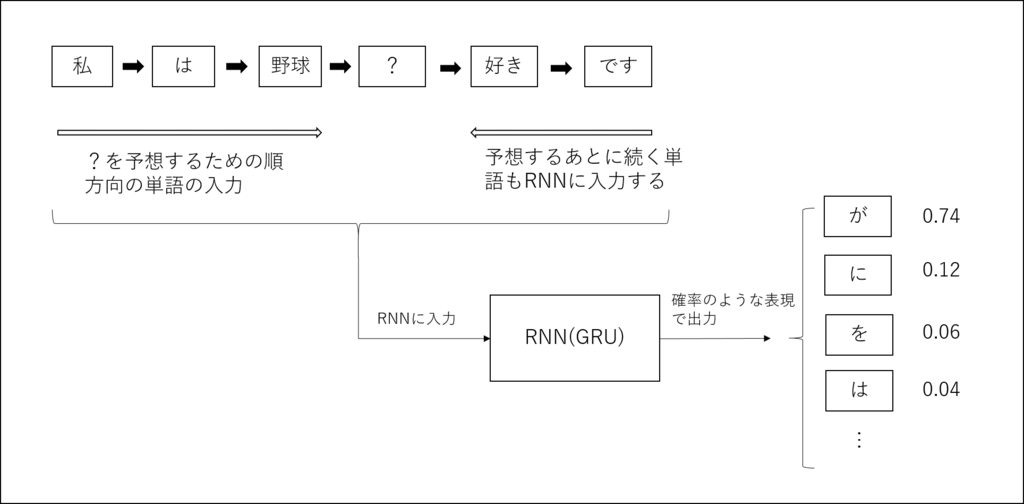

RNNで助詞を予想させるタスクを行う。ただし、ビームサーチが必要になるのは次の文脈が確定されていなからであって、予想する文字の次の文脈を入力素性として利用する。

これは、以前教師なし文章の復元の投稿でも用いた類似したアプローチであるが、単語粒度に拡張し、fastTextを適応してベクトル化して、「てにをは」を修正する問題である。

通常、RNNを文章生成のタスクで利用するには、活性化関数にsoftmaxと損失関数categorical cross entropyを利用することが多い。しかし、鋭利すぎる出力が出ることが多いので、なだらかな出力が欲しかったので、活性化関数にsigmoid、損失関数にbinary cross entropyを用いたモデルで行う。

モデル

Keras2を使ってみました。

github.com

ネットワークのみ記す。

def build_model(maxlen=None, out_dim=None, in_dim=256): print('Build model...') model = Sequential() model.add(GRU(128*20, return_sequences=False, input_shape=(maxlen, in_dim))) model.add(BN()) model.add(Dense(out_dim)) model.add(Activation('linear')) model.add(Activation('sigmoid')) optimizer = Adam() model.compile(loss='binary_crossentropy', optimizer=optimizer) return model

コード全体はgithubを参照にしてください。

データセットを集めるプログラムは付属していないので、適宜各人、適宜、集めてください。

ubuntu用のfastTextバイナリが含まれます。Python3のみ動作検証しています。

実験

- Yahoo! Newsの記事2月1日からのデータを1000MByteの学習データセットをもちいて学習させた

- LSTMではなくGRUを用いた。2560unitも使う巨大なモデルである

- 活性化関数はsigmoid

- 損失関数はbinary cross entropy

- 入力は助詞の周辺の単語19語、出力は助詞の種類

- 単語の分散表現はFacebook社のfastTextを利用して256次元にエンベッディング

- 修正する助詞は「が,の,を,に,へ,と,で,や,の,は,も,ば,と,し,て,か,な,ぞ,わ,よ」に限定した

評価

1. 訂正能力を確認するため、実際にいくつかのキュレーションサイトで試してみることで、定性的に評価する

評価に4meeeというサイトの記事を用いた

2. キュレーションサイトと、Yahooヘッドラインの記事では訂正箇所の大小により差があることを定量的に評価する

評価を4meeeの1000文, 日経新聞の1000文を調べることで、差があるかどうか定量的に評価する

結果

1. 訂正能力を確認. 実際にいくつかのキュレーションサイトで試してみることで、定性的に評価

(4mee.comさまのサイトを参照させていただきました)

(赤い文字が修正ポイントです)

間違いを指摘する例 1.

...いい,の,だろ,う,か,?,」,と,悩む,こと,も,ある,かも,しれ,ませ,ん,ね,。,アラサー女子,が

が 0.43567371368408203 で 0.2292904108762741 は 0.12616075575351715 や 0.07486625760793686 に 0.05115458369255066 と 0.023784229531884193 も 0.014887742698192596 … 以下略

間違いを指摘する例 2.

...理由,で,、,結婚,を,考え,られ,ない,という,方,は,多い,かも,しれ,ませ,ん,。,ですが,、,それ

が 0.9836806058883667 の 0.418474942445755 も 0.1664217710494995 で 0.006275758147239685 は 0.004365661647170782 に 0.0009334951755590737 ...以下略

間違いを指摘する例 3.

...れ,て,いる,こと,は,あり,ませ,ん,。,理由,が,ない,のに,定職,に,つか,ず,に,ふらふら,し

は 0.9380507469177246 で 0.11489760875701904 が 0.07356355339288712 に 0.05326680839061737 や 0.026233579963445663 を 0.01495771761983633 ...以下略

接続詞でだいぶ、異なった出力が得られるようです。人間も意識しないとわからない部分です。

2. キュレーションサイトと、Yahooヘッドラインの記事では訂正箇所の大小により差があることを定量的に評価

これは、日本語としてちょっと標準と離れることがキュレーションサイトでは多い、つまり、権威あるニュースサイトに比べると、訂正箇所がおおいという仮説を証明する。

評価を4meeeの1000文, 日経新聞の1000文を調べることで、差があるかどうか定量的に評価する

|実測値 | 日経 | 4meee | |修正なし | 746 | 491 | |修正あり | 254 | 509 |

カイ二乗検定などを試した結果、別の分布と言えるようだ。別のものであれば、キュレーションサイトと日経のサイトを判別する機械学習モデルの素性に組み入れても良いだろう。

結論

ビームサーチを行わないモデルなので、探索が楽で高速に動作するというメリットがあり、softmax + categorial cross entropyと違って確率表現のように出力するので、しきい値等で、機械学習の結果を採用したり、却下したりすることができる。

また、日本語の「てにをは」は厄介なので、日本語の勉強をしている非ネイティブの人や、研究者の方、日本人だが簡易的な校正が必要な方などの利用ケースが考えられる。

(なにか間違いがありましたら、twitterでこっそり教えてください)

参考文献

[1] LSTMとResidual Learningでも難しい「助詞の検出」精度を改善した探索アルゴリズムとは http://www.atmarkit.co.jp/ait/articles/1611/11/news016_2.html

[2] 第三者委員会調査報告書 http://v3.eir-parts.net/EIRNavi/DocumentNavigator/ENavigatorBody.aspx?cat=tdnet&sid=1450400&code=2432

新しく買ったWindows 10でneologd等の自然言語処理環境を構築する (+ XGBoost)

新しく買ったWindows 10でneologd等の自然言語処理環境を構築する (+ XGBoost)

はじめに

自然言語処理と機械学習とSE的なことを仕事としているのですが、現在務めている会社ではWindowsの利用を強く推奨されることがあります。これは、コンプラインスの関係でセキュリティ管理者が複数のOSを管理するコストは高いからWindowsに限定することが多いという理由に起因しています。

この文章を書いている環境はUbuntu LinuxのLibreofficeを用いています。文字コードがUTF-8だと自然言語処理の観点で何かと都合がよく、MeCabなどの形態素解析エンジンもUTF-8ですし、Python3も内部の処理系がUTF-8で、GolangのRuneや、C++も文字処理粒度はUTF-8のものが増えています。

こういう関係もあって、sjisをハックするなど、あまり技術的にこったことをしたくないというモチベーションのもと、Windowsで形態素解析と、みんな大好きXGBoostを導入するまでの一連の流れを示したいと思います。

ツール属性の攻撃という言葉があって、これが案外馬鹿にできないというか、かなりの攻撃力を誇るので、できるだけ覚えるコスト下げたいという思いもあります。

(この方法は2017年3月段階での、私がいじくってなんとか動かした方法ですので、正しく理解するには公式ドキュメントも注意深く参照することをおすすめします)

計画

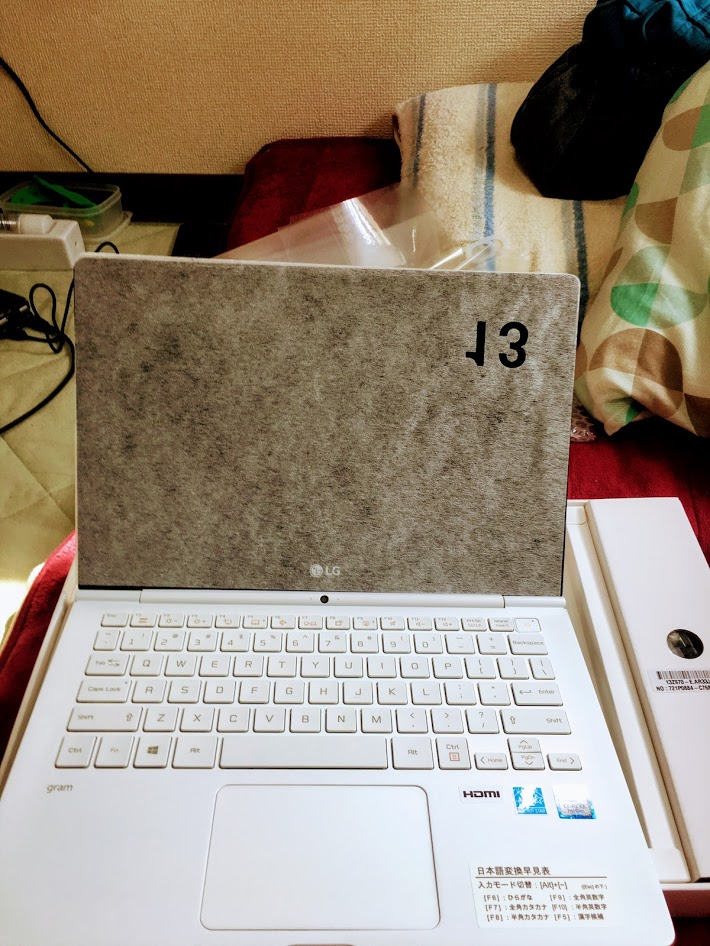

1. Windows 10の持ち運べるノートパソコンであるLG gramの購入と、アップグレード

2. OSをNVMeに移動する

4. mecabとneologdの導入

5. Anacondaとjupyter notebookの構築

6. XGBoostの導入

1. Windows 10の持ち運べるノートパソコンであるLG gramの購入と、アップグレード

本当はMacBook Proがほしいのだが、2017年3月、もっとも高いメモリのモデルでも16GByteまでしかなく、加えて8GByte → 16GByteに変更するのに20000円もかかる。自分で取り替えられる場合、12000円程度ですむ。

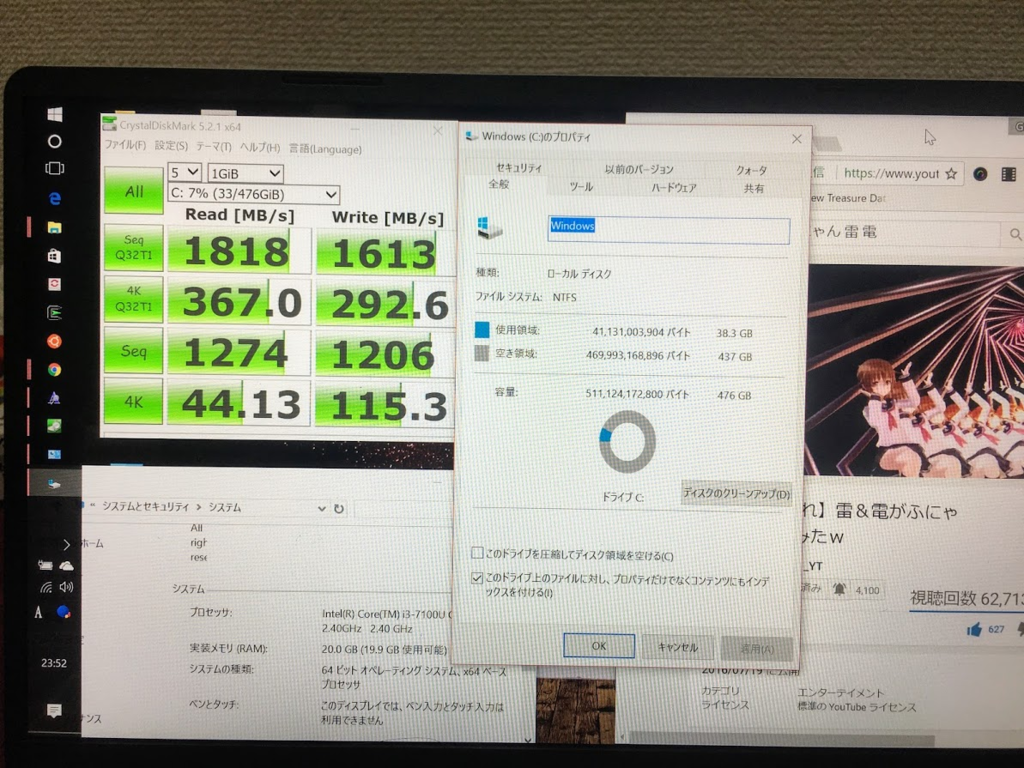

MacBookには、NVMeモデルがない。NVMeはSSDより高速な主記憶装置で、ディスクに大量にアクセスする操作が発生することが多い機械学習ではNVMeであるだけで、かなり処理時間が短縮できることがある。スワップ領域等を作成しておくと、メモリがあふれた時にもマシンが処理落ちして使い物にならなくなる時間が短縮できて大変よい。

CPUは早いほうがいいが、ノートパソコンで重い計算をさせることは私は少ないのでCore i3でいいかなって感じです。

LG gramの2017年のモデルが1キロを下回る軽さで、メモリを追加することも、NVMeに換装することもできます。96000円程度で秋葉原のツクモで10%還元で購入できました。そのポイントを利用してNVMeとDDR4の16GByteのメモリを購入しました。NVMeがsamsung 512GBのモデルで30000円程度,DDR4の16GByteで12000円程度でした。合計で、120000円程度です。

全く文脈を無視しますが、ぼくは小林銅蟲先生を尊敬していまして、料理ブログよく見てるので、あのノリ羨ましいなって思います。

OSをNVMeに移動する

これが一番めんどくさかったです。コントロールパネルからリカバリーディスクの作成を選んで、32GのUSBフラッシュメモリにOSのリカバリディスクを作成しました。

かなり早いUSBフラッシュメモリを用いたのに全く速度がでない。。。4時間ぐらいかかりました。これはMicorsoftの怠慢では。途中で寝てしまいました。

3. 日本語が処理できるようにcmdやcmderの代わりにputty, teratermやcygwind sshを利用する

Bash on WidowsというWindows上にUbuntuが動作する仕組みがあるのですが、コマンドプロンプトや、よくおすすめされるcmderというソフトは、日本語入力やファイルが壊滅的にダメで、これが原因でほんとつらい思いをしました。

よく私が使う回避策は、Bash on Windowsでssh-serverを起動して、teraterm等てアクセスする方法です。面倒ですが今のところこれが一番安定して、日本語が扱えます。

3.1 開発者モードを、コントロールパネルから有効にする

3.2 Windowsの機能の有効化または無効化 → Windows Subsystem for Linux (Beta) → チェックを入れて再起動

3.3 services.mscをコマンドプロンプトに入力 -> SSH Server Broker,SSH Server Proxyの2つのサービスを無効にする

3.3 cmdを立ち上げる → bashと入力 → Linuxのインストール

3.4 Bash on Windowsに入る → sudo apt get install openssh-serverでインストール

/etc/ssh/sshd_configを編集

$ sudo vim /etc/ssh/sshd_config 変更→ UsePrivilegeSeparation no 変更→ PasswordAuthentication yes コメントアウト → #Hostkey /etc/ssh/ssh_host_dsa/key コメントアウト → #Hostkey /etc/ssh/ssh_host_ecdsa/key コメントアウト → #Hostkey /etc/ssh/ssh_host_ed25519/key

コマンド実行(これをやらないとつながらない)

$ sudo ssh-keygen -t rsa -N '' -f ssh_host_rsa_key

sshdを起動

$ sudo /etc/init.d/ssh start

4. mecabとneologdの導入

これもUbuntuのインストール手順に従えば、問題ないです。標準のUbuntuLinuxにはデフォルト入ってないパッケージもあるので適宜入れていきます。

$ sudo apt install mecab libmecab-dev mecab-ipadic $ sudo apt install mecab-ipadic-utf8 $ sudo apt install python-mecab $ sudo apt install python3-pip $ sudo pip3 install mecab-python3 $ git clone --depth 1 https://github.com/neologd/mecab-ipadic-neologd.git $ cd mecab-ipadic-neologd $ ./bin/install-mecab-ipadic-neologd -n

mecabのデフォルト辞書をneologdに変更する

$ sudo vim /etc/mecabrc 変更 → dicdir = /usr/lib/mecab/dic/mecab-ipadic-neologd

動作確認(FGOは標準辞書にない)

$ echo "Fate/Grand Order" | mecab

Fate/Grand Order 名詞,固有名詞,一般,*,*,*,Fate/Grand Order,フェイトグランドオーダー, フェイトグランドオーダー

EOS

5. Anacondaとjupyter notebookの構築

最初Anacondaを使わずに入れようと思ったけど、ubuntuのwheelが通じないことながあって、Anacondaでインストールするのが楽でした。

Anacondaのパッケージを取得

$ wget https://repo.continuum.io/archive/Anaconda3-4.3.1-Linux-x86_64.sh

インストール(sudoするとパーミッションが面倒なのでしない)

$ sh Anaconda3-4.3.1-Linux-x86_64.sh (ひらすらyesで進めていく)

私の環境ではpython3.6のバイナリがAnacondaのPythonですので、Python3.6で実行できるようになります。

$ which python3.6 /home/{yourname}/anaconda3/bin/python3.6

なお、ipythonのkernelが不安定なので、以下のパッチを当てる必要があります。

conda install -c jzuhone zeromq=4.1.dev0

jupyter notebookのパスワードを作成します

In [1]: from notebook.auth import passwd In [2]: passwd() Enter password: Verify password: Out[2]: 'sha1:67c9e60bb8b6:9ffede0825894254b2e042ea597d771089e11aed' <-これをコピーしておきます

jupyter notebookにパスワードを設定

$ vim ~/.jupyter/jupyter_notebook_config.py

コピーした内容を貼り付け

c.NotebookApp.password = u'sha1:67c9e60bb8b6:9ffede0825894254b2e042ea597d771089e11aed'

ついでにjupyterで形態素解析ができるようにする

$ sudo ipython -m pip install mecab-python3

これでClient側のWindowsからwebブラウザ等でjupyter notebookが利用可能です。

例でスクリーンショットを載せます。

6. XGBoostの導入

自分はlibsvm形式で直接xgboostのバイナリに放り込むことが多いのですが、やりかは何でもいいと思います。

$ git clone --recursive https://github.com/dmlc/xgboost

$ cd xgboost

$ make -j4

$ sudo ln -s /home/{yourname}/xgboost/xgboost /usr/local/bin/xgboost

サンプルのアガリクスの有効判定みたいなのをときます。

$ cd demo/binary_classification

$ python mapfeat.py

$ python mknfold.py agaricus.txt 1

$ xgboost mushroom.conf

いろいろ入れられそうですが、この辺にしておきます。

再度になりますが、自分はQiitaとか見てて結構ハマって、よくわかんないなぁとか思っていたのですが、公式ドキュメントで解決することが多かったです。私の今回の方法も、ひと月後には通用しないものになっているかもしれません。

公式ドキュメントを正しく理解することが一番の近道かもしれません。

(何か間違い等がありましたら、ツイッターでお知らせいただけると幸いです。)

alternative illustration2vec(高次元タグ予想器)について

alternative illustration2vec(高次元タグ予想器)について

はじめに

今回はillustration2vecを去年10月に知り、実装法を模索していたが、Kerasでの転移学習と、目的関数を調整することで同様の結果が得られるのではないかという仮説に基づいて、検証実験を行った。

illustration2vecのような画像のベクトル化技術に関してはアプローチは複数用意されており、どのような方法がデファクトかつ、もっとも精度が良いのかわかっていない。

以下、私が考えた3つの方法を記す。

- 1. VGG16などの学習済みモデルの出力部分のみを独自ネットワークの入力にすることで、タグ予想問題に切り替える

- 2. 上記のアプローチをとるが、入力に途中のネットワークのレイヤのベクトルも入力に加える

- 3. キャラクタ判別問題などにタスクを切り替えて、タスク完了後ネットワークを学習させないようにフリーズして、途中のレイヤの出力、ボトルネック層の出力などを素性にしたlogistic regressionにて学習する

1,2は転移学習とよばれる学習済みのモデルを利用して再度学習する方法であるが、ネットワークの出力に近い部分を取り外して任意のネットワークに置換することで別の問題をとくことが可能になる。

この時、よく調整された評価用のVGG16やResNetなどは卓越した特徴量抽出機能を備えている。下手に独自の学習で悪影響を及ぼすより、フリーズと呼ばれる学習を反映しない状態に変換して特徴量抽出器のような使い方をすることができる。

タグの確率表現としての妥当性や多数でのパラメータでの多様性を考えると3が最も良いように見える。これはディープラーニングと既存の実績のある判別問題のアプローチを合成したハイブリットなアプローチである。

先行研究

- Illustration2vec http://illustration2vec.net/papers/illustration2vec-main.pdf

オリジナルペーパ、やってる概要はつかめたのだが、学習用の実装が見当たらず、妄想であれこれいけるんじゃないかと検証していた

タグ予想という名前でプロダクトを出しており、githubで中間層のデータを参照するようなコードの断片を見つけて、自分の考えがそんなに間違いでないことを知る

なお、400次元に出力を限定しているがGPUのメモリを考えれば5000次元ぐらい行けるのになぜ?

実験

- GPUの性能の関係でVGG16を改造することに決定

- 1,2のアプローチの後、性能が出なければ、3のアプローチを導入(1がうまく行ったため行っていない)

- http://danbooru.donmai.us/ というサイトから、scraperを回して画像とタグ情報を139万枚取得。評価者に馴染み深いドメインである必要があったため、艦これのタグが入っているものを優先。

- オプショナルな情報として、アダルトスコアも習得

- 学習時間の関係から5万枚を学習に使用した

- VGG16を用いるため、150*150*3の画像が入力となる

- 出力次元には特に制限を設ける必要性を感じなかったために4096次元にした

- 多くの例ではVGG16の15層までをフリーズするが、性能試験を行ったところ、12層ぐらいのフリーズの方が今回のタスクでは性能が向上した

- Dropoutは性能が改悪することがあったため、BN(BatchNormalization)で対応した

- Activation関数に関しては、linearで出力した後Sigmoidをかけている(意味ない可能性ある)

- 評価関数はbinary_crossentropyを用いている

- optimizerはadam

- 評価いはニコニコ静画の画像をもって行うものとする(学習データに含まれていない必要があるため、最新の投稿を用いる)

ネットワーク

- (2に関して結果から言うと、どうしてもロス率の下がりが悪く、計算リソースの関係で諦めた)

- 1のネットワークに関しての図は、図2を用いた。

- Kerasでのモデル定義のコードを記す

def build_model(): input_tensor = Input(shape=(150, 150, 3)) vgg16_model = VGG16(include_top=False, weights='imagenet', input_tensor=input_tensor) dense = Flatten()( \ Dense(2048, activation='relu')( \ BN()( \ vgg16_model.layers[-1].output ) ) ) result = Activation('sigmoid')(\ Activation('linear')( \ Dense(4096)(\ dense) ) ) model = Model(input=vgg16_model.input, output=result) for i in range(len(model.layers)): print(i, model.layers[i]) for layer in model.layers[:12]: # default 15 layer.trainable = False model.compile(loss='binary_crossentropy', optimizer='adam') return model

結果

良い結果になった。

以下に三つの例を載せる。

(画像の著作権はニコニコ静画及び絵を書いた人に帰属します)

コード

今回は試行錯誤がたくさんあり、コードに微調整の後が大量に見て取れるかもしれない。赦してほしい。

github.com

git cloneする。

git clone https://github.com/GINK03/alt-i2v

画像のデータが必要な方はスクレイピング

(通信速度と頻度に関しては十分注意してください)

bautfulsoupとよばれるモジュールが必要です。

python3 danbooru_datasetgenerator.py --mode=scrape

ダウンロードが完了したら、タグ情報の前処理

python3 alt_i2v.py --maeshori

高速に画像を処理するために、画像をベクトル化してKVSに格納する

numpy, pillow, msgpack, msgpack-numpy, plyvel+leveldbが必要です

python3 alt_i2v.py --build

トレイン

python3 alt_i2v.py --train

タグ情報を予想してみる

python3 alt_i2v.py --pred foojpg bar.jpg

結論

- タグの予想は意外と簡単にできるし、精度も悪くない。

- 今回作成したネットワークを用いることで類似画像検索や、その画像が何を示しているのかを概念的に把握することができる。これはSingle Shot DetectionやYolo V2とは異なったアプローチで状況の把握が可能になることを示している

- 別に400次元に出力を限定する意味を感じなかったが正しかったようだ。RNNやってれば10000次元に到達することなんてザラだし。

謝辞

- 小林さんちのメイドラゴンのED 「イシュカン・コミュニケーション」

「なんでルールはきゅうくつ?胸がしまっちゃうね、下等で愚かな価値観。だめって決定する、倫理なんていりませんよ」の流れ最高ですね。

教師なしRNNによる連続した不完全情報(主にテキスト)の補完

教師なしRNNによる連続した不完全情報(主にテキスト)の補完

背景

Google(や、過去の私のブログの投稿)などで低解像度の映像を高解像度化する方法は、GANを使うことでわりとうまくいきました。

テキストにも同じような問題が適応できるのかって思うことがあります。RNNはすでに記述されている文字をヒントとして次の文字を予想することができます。

その特性を利用して、情報が失われたテキストから復元を試みる例を示します。

(また、戦時中の戦艦に乗っていた搭乗員の劣化した手記から情報を復元したいという思いがあります。手記の海水に沈み腐敗が進んでいたり、筆記が乱れていて解析が困難であったりという点を補完できれば良いと思います。彼らの思い、可能な限り現代に蘇らせたいと思います。)

先行研究

- 今回は見当たらない(ほんとに存在しないんだったら、論文出したい)

手法

- RNNで欠落した連続する情報を周辺の単語分布から、情報を復元しようとした場合、どの単語が尤もらしいかどうか予想するタスクに置き換える

- 一般的なテキスト生成タスクでは、生成タスクの素性とするのは、それまでの系で、決定された文字列である。これを前方までに拡張する。なお、この時、欠落した情報を加工することなく、そのまま学習データとして利用するので、教師なし学習である。

- 最も尤度が高い欠落情報から埋めていき、再帰的に尤度がたいところを探索することで、より確度の高い復元を試みる

- 数式も載せようと思いましたけど、Kerasからじゃ数式レベルの粒度で見えないから意味ないんだよね...[3]

- キャラクタ数多すぎる問題が日本語では起きるので、fastTextでキャラクタを256次元に圧縮したものを用いてます。

実験

- Keras(TensorFlowをバックエンドとする)

- 日本の戦時中の手記[1]と、新約聖書[2]を利用する

- 全体の10%、20%、30%をランダムに情報を欠損させた場合、未知の文章に対しての復元能力を定性的に確認する

- 全体のドキュメントの8割を学習に、2割を評価に用いる

- GRUを用いたRNNでunit数は1024

- BatchNormalizationの論文の基づく、パラメータで導入

- Dropoutを0.5のパラメータで導入

- OptimizerにAdamを利用

- 全結合層はsoftmaxで単語の素性数を出力

- 目的関数にcategorial cross entropyを利用

- epoch 160

評価

定性的な評価では概ね良好な結果を示した。

欠落する情報が50%を超えるとRNN特有の再帰構造があちこちに観測され、微妙にわからなくなってくるが、10%程度ならほぼ正しく、30%程度ならぎりぎり読めるようにみえる。

10%欠落した例1:聖書

驚き恐れて、この獣に従い、そればりか、こ■獣に■威を授けた竜を拝むようになっ■。彼らはま■獣をも拝■で、■これほど偉大な者を見たことがな■。だれ獣と戦■て■てる■ろうか」と言った。■の獣は高ぶり、神を汚す言■を吐き■ご■わずかな期間だけ活動■ることが許されで、その■は、神に対し■汚しごとを言い始■た。神とその御使いと、そこ■いる神の民をののしった。その■はクリスチャ戦い■挑んで打ち負かす力が与え■■、国民、部族、種族、■族を支配する力が与えられた。地上に生■ている人で、キリス命の書に、その名前が書き■されていない者は皆■彼を拝むようにな■。■■こと■何を意味しているのか考えてみなさい。クリスチャンは迫害によっ■■え■れて行く。そのことが自分の身に■った時にも■あわてずに心の備えを■ていなければ な。迫害する者がクリスチャンを殺して■、彼ら自身も■ず殺されることになる■だから、クリスチ■ンはす■てを■の御手にて耐え忍ぶことができる■私はまた■もう一頭の獣が地から■って来るのを見た。■■は、おそらく偽預言者のことであろうの獣には、子羊のような二本の角があって、■のように、すごみを■び■ものの言い方をした。この■は、先の獣が持っていらゆる権威を、その獣の前で行使し、地に■む人■に、無理矢理■致■的な傷の治った獣を拝ませた。また、人々■前で燃える火を天から降■せる■さらに、地上の人々を惑わし、致命的な傷を受けながらも■き■った先の獣■像を造るよ地上に住む■■に命じた。偽預言■は魔術的なやり方で、その■の像がものを言っているよ■に見せ■■、その獣の像を拝まを皆殺させた。ま■、あらゆる種類、あらゆる階層の人々の右の■■額に、印を■けさせた。その印の■■てい■い者は、だを■■たり売■たりできないようにし■■まった。その印■、その獣の名前であり、その名前はま■数字でも表された。その■こうと■るなら、天か■の知恵が必■で■る。■の数字の意味の解ける人は、解いてみるが■い。その数字は、■る特定のしており、六百六十六である。これは反キリストである

10%補完した例1:聖書

驚き恐れて、この獣に従い、そればかりか、この獣に権威を授けた竜を拝むようになった。彼らはまた獣をも拝んで、、これほど偉大な者を見たことがない。だれがこの獣と戦っていてるだろうか」と言った。この獣は高ぶり、神を汚す言葉を吐き、ごさわずかな期間だけ活動することが許された。そこで、その人は、神に対して汚しごとを言い始めた。神とその御使いと、そこにいる神の民をののしった。その獣はクリスチャンに戦いを挑んで打ち負かす力が与えられ、国民、部族、種族、民族を支配する力が与えられた。地上に生きている人で、キリストの命の書に、その名前が書き記されていない者は皆、彼を拝むようになる。このことは何を意味しているのか、よく考えてみなさい。クリスチャンは迫害によって与えられて行く。そのことが自分の身になった時にも、あわてずに心の備えをしていなければならない。迫害する者がクリスチャンを殺しても、彼ら自身も必ず殺されることになる。だから、クリスチャンはすべてを神の御手にゆだねて耐え忍ぶことができる。私はまた、もう一頭の獣が地から帰って来るのを見た。それは、おそらく偽預言者のことであろう。この獣には、子羊のような二本の角があって、そのように、すごみを滅びるものの言い方をした。この男は、先の獣が持っているあらゆる権威を、その獣の前で行使し、地にやむ人々に、無理矢理の致命的な傷の治った先の獣を拝ませた。また、人々の前で燃える火を天から降らせる。さらに、地上の人々を惑わし、致命的な傷を受けながらもべきまった先の獣の像を造るように、地上に住むの中に命じた。偽預言者は魔術的なやり方で、その方の像がものを言っているように見せまし、その獣の像を拝まない者を皆殺させた。また、あらゆる種類、あらゆる階層の人々の右の手そ額に、印を付けさせた。その印の振っていない者は、だれも物を持ったり売ったりできないようにしてしまった。その印は、その獣の名前であり、その名前はまた数字でも表された。その数字をそこうとするなら、天からの知恵が必要である。その数字の意味の解ける人は、解いてみるがない。その数字は、ある特定の人間を指しており、六百六十六である。これは反キリストである

30%欠損した例2:ミッドウェー海戦手記

巨大な戦艦■らばこれら■■■を解決■■るので、■に■■司令・有賀大佐が移乗を強く■申したとも■え■れています。■嵐」■野■」か■「■■」へ■「萩風■■■風雲■から■■■」へ、「巻雲■から「■奥」■、そ■■「濱風」は■山城■へ、「磯風」は甲標■■艦「千代■■■■■艇による■乗■は■変苦労し■と言います■■谷風」が知る由もありません■し ■■闘はこの移乗■業を間接的に助け ■になっ■■評■■れ■いま■。もしドー■■レスが「谷風」を攻撃せずにそのまま■■して■■ら、主隊■■雲■動部隊■受け■いた可能■もあると言われているからです。

30%欠損を復元した例2:ミッドウェー海戦手記

巨大な戦艦ならばこれらの問題を解決でするので、特に四駆司令・有賀大佐が移乗を強く具申したとも伝えられています。「嵐」「野分」から「榛名」へ、「萩風」「舞風」から「長門」に「「風雲」から、「嵐」へ、「巻雲」から「浦奥」へ、そして「濱風」は「山城」へ、「磯風」は甲標上母艦「千代1時3。前日はうこりが大きく、6艇による移乗がは結変苦労したと言います。「谷風」が知る由もありませんでしたが、「谷風」の死闘はこの移乗作業を間接的に助けたことになったと評価されています。もしドーントレスが「谷風」を攻撃せずにそのまま、そしていたら、主隊に南雲機動部隊は移乗作業中に攻撃を受けていた可能性もあると言われているからです。

感想

コード

コード全体はgithubにおいておきます。多分そのまま利用できるかと思います。

github.com

git cloneしてファイルを取得

$git clone https://github.com/GINK03/keras-unsupervised-rnn-negentropy.git

トレインの方法です。デフォルトで全体の8割を使用します。デフォルトではmidwayデータセットを用います。適宜コードを変えてください。

$python3 rnn_negentropy.py --train

評価の方法です。testcast.pyに必要な評価対象文章を追加してください。結果はresult.txtファイルへ出力されます。

$python3 rnn_negentropy.py --eval

今回も結構な分量になったので、モデルだけ。

def build_model(maxlen=None, feats=None): print('Build model...') situations = 4 vector_size = 256 model_text = Sequential() model_text.add(Reshape( (maxlen, vector_size, ), input_shape=(maxlen, vector_size))) model_text.add(GRU(int(128*8))) model_text.add(BN(epsilon=0.001, mode=0, axis=-1, momentum=0.99, weights=None, beta_init='zero', gamma_init='one', gamma_regularizer=None, beta_regularizer=None) ) model_text.add(Dropout(0.5)) final_model = Sequential() final_model.add(model_text) final_model.add(Dense(len(feats))) final_model.add(Activation('softmax') ) optimizer = Adam() final_model.compile(loss='categorical_crossentropy', optimizer=optimizer) return final_model

参考文献

[1] 駆逐艦に見るミッドウェイ海戦 http://www.warbirds.jp/truth/midway.html

[2] 新約聖書 http://bible.salterrae.net/kougo/pdf/

[3] RNNの数式的説明: https://micin.jp/feed/developer/articles/rnn000

近況

なんとか生きています。進捗が発生させられないくてツライ。